Jakarta, Komite.id – Kali ini penampilan Jensen Huang di Computex Taipei 2024 memang istimewa & luar biasa karena menjadi the first global keynote NVIDIA selama 4 tahun, artinya sejak Covid 19 Nvidia tidak membuat keynote besar. Jensen memang mengatakan bahwa banyak sekali yang ingin di luncurkan & diperkenalkan di Computex 2024 Taipei ini dan memilih hari khusus dan stadion besar untuk keynotenya yang selama 2 jam lebih, karena menjadi momentum NVIDIA meluncurkan Accelerated Processor Sulution dari Nvidia untk mendukung AI Revolution ala Nvidia.

Meskipun Nvidia bukan foundry chip atau pabrik pembuat chipset seperti TSMC yang juga perusahaan Taiwan, namun Nvidia tetap merancang khusus chip processonya, sehingga Simulasi cahaya & material menjadi tantangan untuk merancang accelerated processor yang canggih.

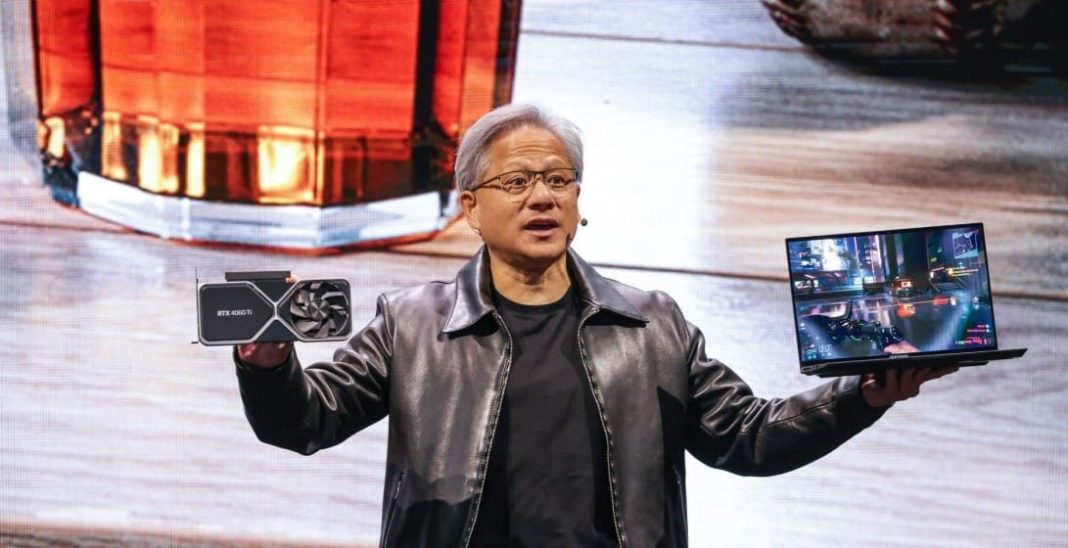

Perkembangan GPU Nvidia dalam 6 tahun – RTX Series.

6 tahun yang lalu Jensen demo di Computex, proses rendering video dengan GPU Cuda membutuhkan waktu beberapa jam. Dalam waktu 1 dekade riset maka proses rendering video yang sama ini menjadi hanya dalam hitungan detik, 15 detik dengan GPU terbaik saat ini. Kemudian NVIDIA meluncurkan 3 teknologi fundamental: 1. Hardware Accelerator; 2. AI Processing dengan Nvidia Tensor Core GPU terbaru; 3. Algoritma Terbaru.

Dalam waktu kurang dari 5 tahun. Dengan menjalalankan GPU Cuda dan CPU. Tahun ini kita gunakan 3rd generation arsitektur RTX GPU yang bisa rendering realtime dalam hitungan detik. RTX diluncurkan dengan 2 produk utama:

- RTX 500 Mobile 14” AdaGPU menjalankan Ray Tracing Rendering AI realtime 60 fps (frame/sec) lebih canggih dari highend playstation.

- RTX 4060 TI untuk Gamers Inti (Core) sudah mulai diproduksi oleh manufaktur computer Taiwan. Teknologi & Algoritma AI memungkinkan ini semua berjalan dengan sangat cepat karena setiap pixel yang di rendering atau di komputasi, maka algoritma AI sudah memprediksi 7 pixel berikutnya meningkatkan kinerja sangat signifikan cepat dan hemat energi.

Di Back Office kantor pusat Nvidia tersedia Super-computer untuk pelatihan model, running S/W, Deploying S/W untuk membangun algoritma dari devices yang dirancang Nvidia seluruh dunia. NVIDIA menggunakan AI untuk merender scenes (gambar) & membuatnya hidup.

Nvidia Ace Avatar Clouds & Membuat Avatar Human AI hidup.

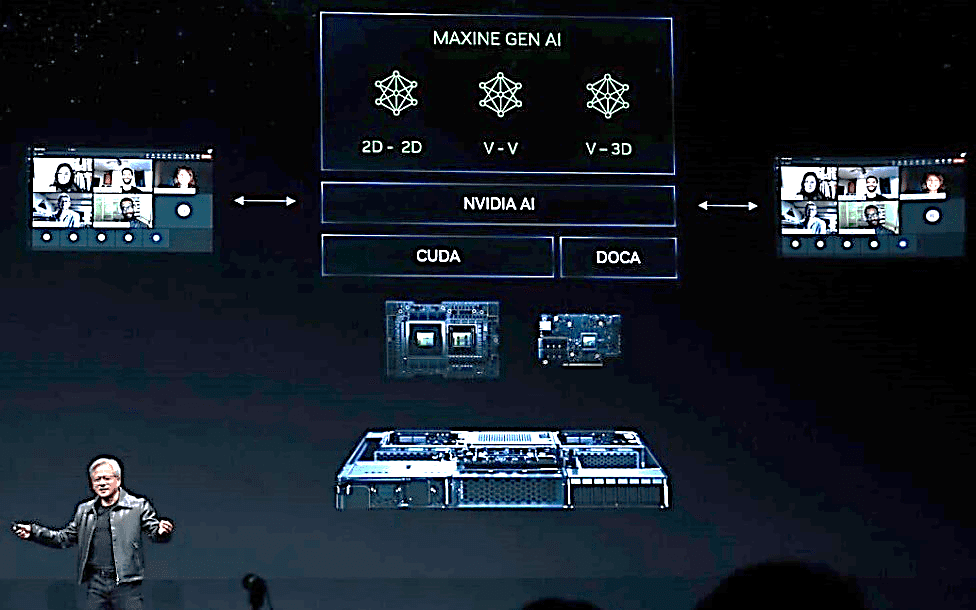

Nvidia mengumumkan Nvidia Ace Avatar Clouds Engine yang dirancang untuk animasi agar dapat membuat digital Avatarnya hidup memanfaatkan beberapa teknologi mainstream karakter/ kapabilitas manusia antara lain: 1.Speech Recognition, 2.Text to Speech,

- Natural Langguage Understanding or LLM (Large Langguage Model). Dengan ketiga teknologi ini terutama LLM memungkinkan AI menggunakan sound (bunyi) yang di hasilkan oleh voice (suara) anda menganimasi wajah anda. Teknologi canggih menggunakan bunyi dan ekspresi ketika anda berbicara meng animasi sikap & tingkah kita, semua ini keseluruhannya dilatih (t oleh AI dalam hal ini LLM & ketiga teknologi diatas. Harus berhati hati karena teknologi AI ini juga digunakan oleh hackers untuk menciptakan Deep Fake yang berbahaya bagi masyarakat awam & dunia sosial politik.

Kini dengan Clouds & Accelerated Computing, NVIDIA memiliki jasa solusi antara lain Pretrained model ( Model Pra Pelatihan) yang dapat di kembang-kan, rubah dan tingkatkan untuk aplikasi anda untuk membuat scenario cerita (story) anda, yang kemudian dapat anda jalankan (deploy) di Clouds atau di Device anda.

NVIDIA memiliki Tensor IT Nvidia Deep Learning Optimizing Compiler di backend yang sangat massif, yang dapat anda manfaatkan di Nvidia GPU juga di standar industry backend yang anda jalankan di device apapun. Mari kita amati realtime scene yang di render sepenuhnya dengan Ray Tracing memanfaatkan banyak sumber cahaya, global luminasi, sehingga anda dapat melihat bayang (shawdow) yang indah & simulasi fisik.

Perhatikan juga rendering yang indah dari characters menggunakan Nvidia Engine 5 bermitra dengan pembuat avatar framework & tools maker, sehingga dialog film tidak lagi scripted. Bayangkan anda dapat langsung berbicara realtime dengan karakter Avatar anda karena Avatar nya sudah disusupi (infused) dengan AI LLM untuk dapat berinteraksi dengan manusia dan dapat mengerti apa yang anda maksudkan dan berinteraksi realtime secara natural. Semua animasi fasial / muka dilakukan dengan Generative AI & LLM.

Sekarang seorang producer dimungkinkan untuk menghasilkan berbagai macam karakter sesuai imaginasi dan masing masing karakter memiliki domain knowledge (pengetahuan bidang) masing masing yang dapat di sesuaikan, sehingga setiap game semakin dapat berinteraksi unik & natural. Nvidia dan AI menjadi bagian penting & membentuk masa depan industry video game & software game, bukan saja sekedar rendering dan sintesis dari lingkungannya dan AI juga dapat animasi karakter/aktornya.

IBM Systems S360 hingga IBM PC merevolusi computer dengan konsep CPU, Memory & IO yang kemudian ditularkan ke IBM PC, sehingga yang canggih menciptakan pembuatan aplikasi software yang bisa berjalan diberbagai platform dan versi hardware hingga kini selama 60 tahun dan bernilai triliunan USD pada semua data center hingga hari ini.

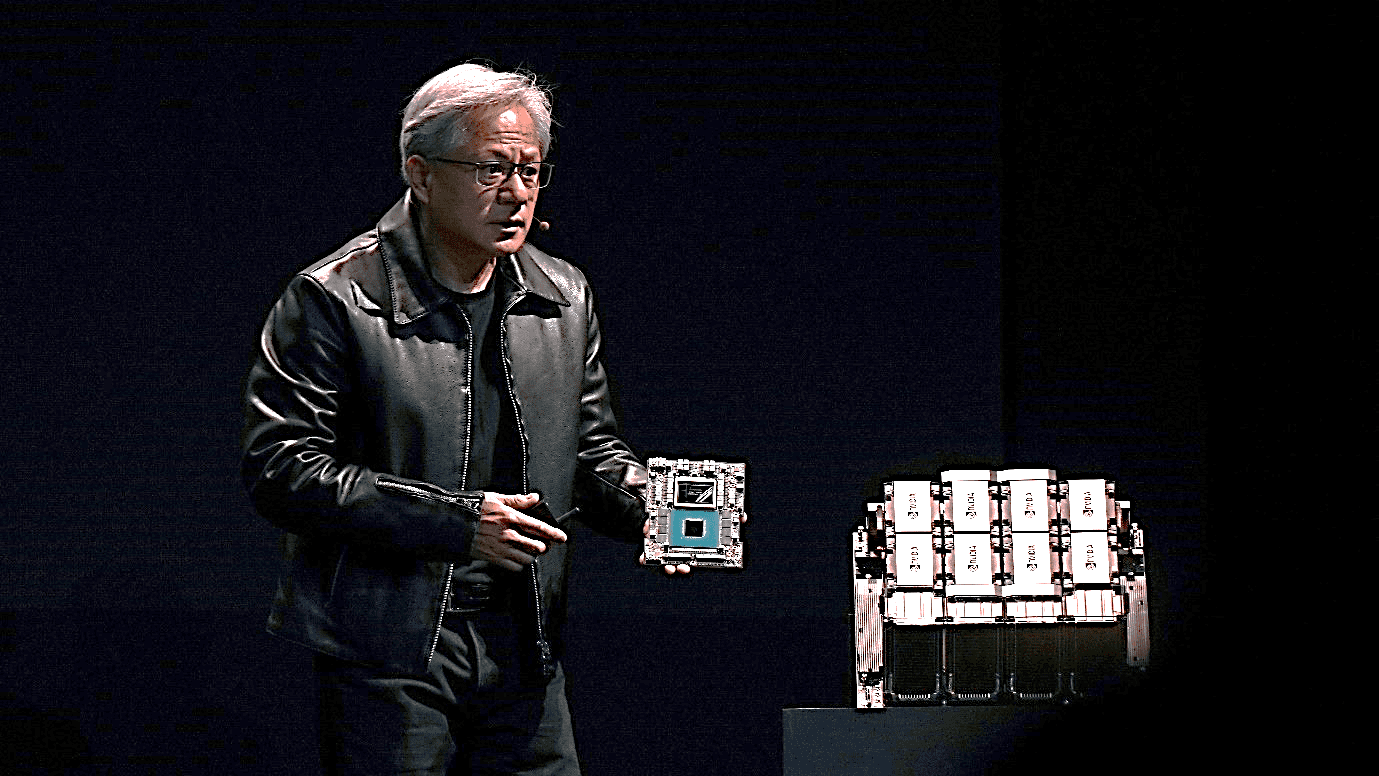

Era Accelerating Computing (ACC) & berakhirnya Moore Law Peningkatan Kinerja CPU

Dua trend fundamental sedang berlangsung:

- Berakhirnya Moore Law, dimana CPU dapat mengkatkan 10x kinerjanya setiap 5 tahun dengan harga dan penggunaan energy yang sama. Namun sayangnya sangat sulit untuk meningkatkan terus kinerja CPU ini. Jadi dibutuhkan inovasi computing yang baru yang menjadi topik artikel ini yaitu Accelerating Computing & Generative AIsebagai arah pengembangan computing kedepan bersamaan dengan berkembangnya teknologi Deep Learning.

Sangat sulit mengembangkan ACC ini karena masalah Stack, lebih sulit dari General Purpose Computing m(enggunakan CPU. Tentu CPU harus dihargai sebagai suatu inovasi dimasanya yang luar biasa dan fleksibel untuk menjalankan high level software (programming languages), compilers

Namun, sayangnya CPU tidak dapat meneruskan scaling Moore Law nya dan sudah jenuh, sehingga dibutuhkan inovasi & pendekatan baru è ACC Stack (Tataran/Lapisan) yang harus di reka yasa (engineered) dari atas kebawah top down & bottom), baik dari lapisan (stack) paling atas, chip design ke Systems, S/W, Algoritma dan Aplikasi.

MASA DEPAN: DATA CENTRE IS THE COMPUTER

- Trend kedua adalah memecahkan masalah Data Center(DC) menuju paradigma Data Center is the computer dan konsep Software Defined DC.

Dimasa lalu PC & Smartphone kita adalah computer yang menjalankan aplikasi, namun kedepan Data Center yang menjadi computer nya, karena processing data dan aplikasi di simpan tersebar di berbagai lokasi di Data Center, bukan individu gadget PC.

Jadi harus optimasi dari Chips, CPU (PC), S/W, NIC, Switch dari ujung ke ujung cara distributing Computing nya.

- ACC merupakan multi bidang (domain) stack nya, sebelumnya hanya satu atau domain tertentu saja. Misalnya algoritma & S/W stack (tumpukan lapisan Computing) yang dijalankan, untuk misalnya aplikasi domain Computation

biologi atau domainflow dynamic physics masing masing domain ilmu memiliki perbedaan domain yang besar dan stack yang khusus model computing yang baru. Itulah sebabnya teknologi ACC membutuhkan waktu hampir 30 tahun untuk dapat diwujudkan oleh banyak engineer, developer aplikasi dan digunakan oleh banyak pengguna.

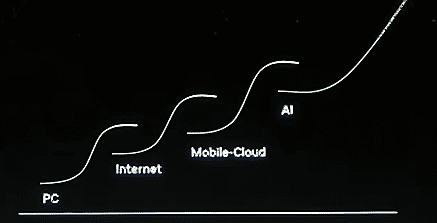

Kini waktu yang tepat untuk menciptakan dan membangun model computing yang baru, karena Nvidia mempunyai 4 juta developer, 3000+ aplikasi, 40 juta Nvidia Cuda download, Juga 5,000 starup dan 40,000 enterprise pengguna diseluruh dunia untuk mewujudkan dan implementasi ACC. Garis depan & kritis dari era computing baru yang lebih murah & efisien, era ACC menuju era revolusi AI dimana sebelumnya tahun 1980 adalah awal dari era revolusi PC.

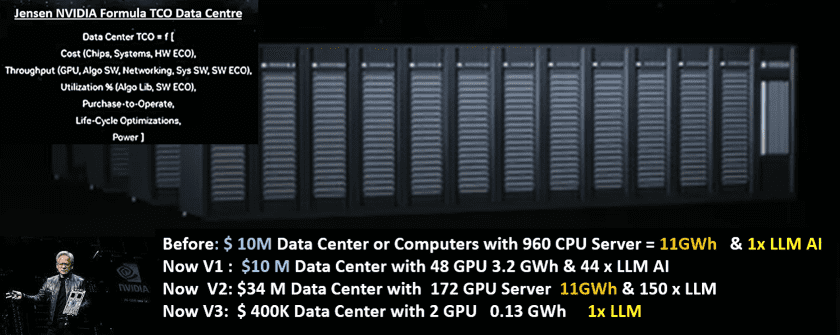

Pada Teknologi DC yang lama, $ 10 juta DC terdiri dari 960 CPU Server, Switches, Cabling dan memproses serta melatih hanya satu unit LLM AI model butuh 11 GWperH (GW perjam).

Karena sekarang Komputer adalah DataCenter, maka yang dibuat semakin efisien adalah Data Centernya bukan lagi computer nya.

Dengan investasi yang sama kini, $10 juta DC bisa membeli 48 GPU Serverdan menghasilkan 44 unit LLM (Large Langguage Model) AI, bayangkan peningkatan sebesar 44 kali dengan investasi yang sama $10 juta.

Bayangkan jika Power 11 GWph dijadikan patokan maka bisa menghasilkan 150 unit LLM AI artinya 150 kali lebih besar outpunya dengan 172 GPu

Jika yang 1 LLM AI yang dijadikan output, maka hanya dibutuhkan investasi $400K dengan 2GPU Server dan hnya 0.13GWh luar biasa hematnya jika dahulu harus menggunakan 960 CPU dan membutuhkan power 11 GWh.

Itulah sebabnya Jensen mengatakan kita berada di garis depan transformasi Data Center memanfaatkan Accelerating Computing.

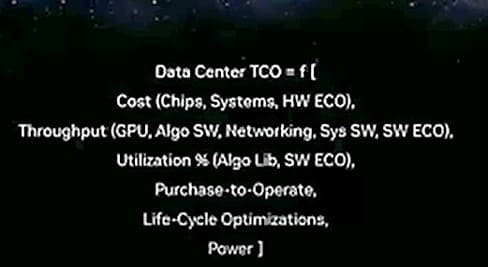

Untuk meperjelas konsep baru Data Center is the computer, maka Jensen membuat rumus TCO Data Center Masa depan, untuk membantu para investor Data Center era AI dengan konsep ACC (Accelerated Computing Concept).

TCO (Total Cost of ownership) Data center sangat terngantung pada factor dari Chip yang digunakan, apakah CPU, GPU Systems, juga System Hardware Konfiguasi dari Switch; Algoritma hingga Aplikasi. Formula/ Rumis yang kompleks untuk menentukan TCO sebuah data Center modern.

Analoginya seperti sebuah Hotel, jika tidak ada tamu yang menginap, maka biaya untuk menjalankan nya akan sangat mahal sekali, karena harus ada perhitungan factor utilisasinya. Software, Library & Apps juga factor yang harus diperhitingkan. Pengoptimalan siklus hidup mulai dari saat Anda membangun hingga saat penerapan, termasuk penyusutan, semuanya menentukan TCO investasi Anda. Karena saat ini DC adalah insinyur yang ditentukan perangkat lunak (SWD) yang terus mengembangkan perangkat lunak & perpustakaan produktivitas, aplikasi yang lebih baik.

Software, Library & Apps juga factor yang harus diperhitingkan. Pengoptimalan siklus hidup mulai dari saat Anda membangun hingga saat penerapan, termasuk penyusutan, semuanya menentukan TCO investasi Anda. Karena saat ini DC adalah insinyur yang ditentukan perangkat lunak (SWD) yang terus mengembangkan perangkat lunak & perpustakaan produktivitas, aplikasi yang lebih baik.

Itulah sebabnya kita berada di era new computing. Lihat lanjutan di Part II dari Keynote Jensen Huang.